26 мая 2026

Хроники Парапапикса

Он приходит в себя от вибрации. Стук. Скрежет. Ещё один удар - что-то отвалилось и покатилось в сторону. Сквозь узкий иллюминатор посадочного модуля бьёт оранжевый свет. Пыль. Везде пыль.

- ЦУП, я «Буран-6». Произошла жёсткая посадка. Требую оценку состояния.

Ответа нет.

Система жизнеобеспечения скафандра уже запустила вентиляцию. Тихий, монотонный гул - воздух проходит через фильтры, очищается, возвращается обратно. Этот гул будет с ним всегда. Он ещё не знает этого.

Модуль накренён. Люк в шлюзовую камеру зажат - открывается только наполовину. Он протискивается боком, царапает броню плеча о деформированную сталь.

Наружу - через аварийный люк. Ноги тонут в красной пыли по щиколотку.

Первый шаг. Левая нога. Никто не снимает. Никто не аплодирует.

- ЦУП, я на поверхности. Модуль повреждён. Связи с орбитальным кораблём нет. Прошу инструкций.

Он ждёт.

Три минуты. Пять. Десять.

Потом в наушниках щёлкает - короткий, сухой сигнал. Текстовое сообщение вплывает на внутренний дисплей шлема.

*«Буран-6, сигнал слабый, приём нестабильный. Сообщите координаты и состояние систем. Дальнейшие инструкции после расчётов. Ждите. ЦУП.»*

Ждите.

Он смотрит на красную равнину, уходящую к горизонту. Ни холма, ни скалы. Ни тени. Только пыль, камни и небо цвета грязной охры.

Решение приходит через восемнадцать часов.

*«Буран-6. Модуль не подлежит восстановлению. Запасов кислорода на 45 суток. Ближайшая цель - колония „Север-2“. Координаты переданы. Расчётное время в пути - 380 суток. Система жизнеобеспечения скафандра рассчитана на 500. Идите. ЦУП.»*

Колония. Он почти улыбается. Там будет баня. Холодильники с настоящими продуктами. Мороженое. Кировского хладокомбината. Вафельные стаканчики.

Он сам это обещал. На презентации. Зал смеялся, аплодировал. Он верил. Или хотел верить.

- ЦУП, принял. Начинаю движение.

Через две минуты:

*«Принято. Связь каждые 24 часа в установленное окно. Ждите сообщений. ЦУП.»*

Он делает первый шаг. Второй. Третий.

Экзоскелет тихо гудит, подхватывает его вес. Идти легко. Слишком легко. Но вокруг - не тренажёрный зал. Красный песок. Красные камни. Красное небо.

Ни одного зелёного пятна.

Ни одного зелёного пятна, только зеленеет крупная надпись РОСКОСМОС на спутниковой антене-тарелке

Но он пока не заметил её, к тому же почти ни когда туда не падает взгляд

---

Он шёл уже десять суток, когда ИИ выдал уведомление:

*«Внимание. Сегодня - 8 марта. Международный женский день. Рекомендуется поздравить женщин экипажа.»*

Он остановился. Сбросил с плеча тарелку антенны - тяжелую, неудобную, которую тащил с собой, потому что без неё не будет связи. Прислонил к камню.

Женщины.

Он не видел женщин больше года. Не считая собственного отражения в стекле шлема. Не слышал их голосов. Не чувствовал их запаха.

Он попытался вспомнить лица. Жена. Ушла. Дочь. Не разговаривает. Мать... мать, кажется, ещё жива. Или уже нет? Он не знал. Он вообще мало что знал о своей жизни до Марса. Воспоминания были как куски разбитого зеркала - острые, но бесполезные.

Он вспомнил старую мем с Адриано Челентано: «8 марта - женский праздник, не нужно меня впутывать»

Он произнёс эту фразу вслух, с той же брюзгливой интонацией:

- не нужно меня впутывать...

И замолчал. Потому что теперь его никто не поздравлял. Никто не доставал. Никто не звонил.

- А зря, - сказал он тихо. - Хоть бы достали.

Он нашёл 8 камней. Крупных, ровных. Расчистил песок и выложил их кругом. Круг, как кольцо. Как обещание, которое он не сдержал. Как женщина, которая ждала, а он не пришёл.

Он постоял, глядя на круг. Потом закинул тарелку на плечо и пошёл дальше.

Круг остался. Через месяц ветер заметёт его песком. Но сейчас он был - правильная геометрия среди красного хаоса.

Вечером, на стоянке, он выложил квадрат. Ритуал, который он придумал для себя: каждый вечер - квадрат из камней, чтобы отметить место ночлега. Чтобы оставить след. Чтобы доказать - себе - что он ещё человек, а не животное, которое ложится там, где устало.

Квадрат получился кривоватым. Но угол был прямым. Почти.

Он лёг. Скафандр загудел, подстраивая температуру. Атомная батарея на спине - новейшая разработка, заряд на десятилетия - ровно питала системы.

Он закрыл глаза.

Женщины. Ему снились женщины. Он не помнил их лиц, только руки. Тёплые. Мягкие. Они гладили его по голове, а он отворачивался. Он всегда отворачивался.

Он проснулся оттого, что плакал. Слёзы впитывались во внутренний слой скафандра. Он вытер лицо перчаткой и встал.

Новый день. Новый квадрат вечером. Новый километр.

Он начал ненавидеть скафандр. Левая лопатка чесалась так, будто там зашили муравья. Чесалка на предплечье не доставала. Экзоскелет блокировал движение плеча. Он терся спиной о стенки, пытался сжать мышцы, чтобы создать иллюзию движения.

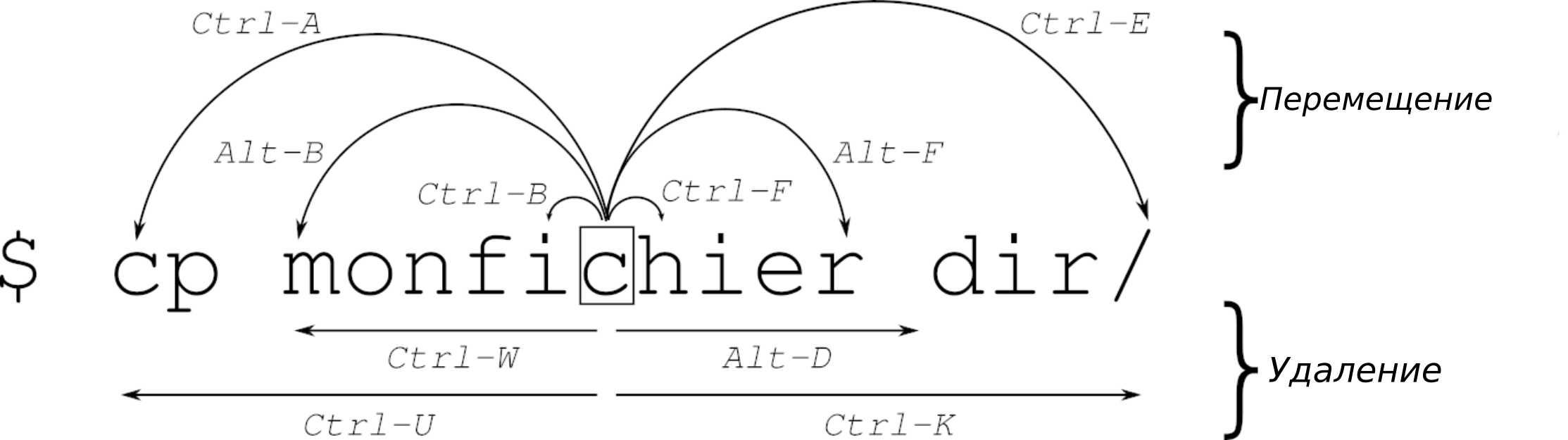

- ИИ, можно разблокировать сустав?

*«Разблокировка приведёт к риску повреждения уплотнительных шлангов. Доступ ограничен протоколом безопасности.»*

- Мне нужно почесаться!

*«Рекомендуется использовать чесалку на левом предплечье для отвлечения внимания.»*

- Я не могу достать до лопатки левым предплечьем!

*«Запись сохранена. Анализ эмоционального состояния показывает повышенный уровень раздражения. Рекомендуется дыхательная гимнастика.»*

Он хотел закричать. Не закричал. Кричать - тратить кислород. Кричать - бессмысленно.

Через несколько недель зуд прошёл. Исчез. Тело сдалось. Но психика не могла отпустить.

Теперь ему казалось, что кто-то смотрит в спину. Именно в то место, где раньше чесалось. Осязаемое, физическое чувство чужого взгляда. Он оборачивался - никого. Только красная пустыня.

Это были галлюцинации. Он знал. Но не мог отделаться.

*«Внимание. Сегодня - 9 мая. День Победы. Рекомендуется поздравить ветеранов.»*

Он шёл уже больше двух месяцев. Тарелка на плече натирала плечо, но он привык. Экзоскелет гудел ровно. Атомная батарея отрабатывала свою колосальную стоимость.

Он остановился, сбросил тарелку, прислонил к камню. Нашёл десять камней - покрупнее, помассивнее. И выложил звезду.

Верхним лучом он указал на запад - туда, где через сотни километров стояла непостроенная колония. Туда, где он когда-нибудь построит стену.

Он выпрямился, посмотрел на свою работу. Звезда на красном песке - единственная геометрически правильная фигура на много километров вокруг.

- С Днём Победы, - сказал он пустоте.

И вдруг - откуда-то из детства, из самой глубокой щели памяти - всплыли строки.

Он не помнил, кто их читал. Может, учительница в школе. Может, дед. Может, голос из репродуктора на параде.

Он произнёс их вслух, медленно, как молитву:

> *«Идут ополченцы в осеннем мраке,

> Неся круги миномётных плит.

> А где-то накапливается к атаке

> Сибирских дивизий живой гранит.»*

Он замолчал. Посмотрел на тарелку антенны - круглую, тяжёлую, похожую на миномётную плиту, которую он таже нёс на плече через всю пустыню.

Постоял минуту. Потом закинул тарелку, поправил лямку и пошёл дальше.

Звезда осталась. Камни не сдует ветром. Может быть, через сто лет кто-нибудь найдёт её и подумает: «Здесь был человек. И он помнил».

Шли месяцы.

Он перестал замечать красный цвет. Глаз привык. Иногда ему казалось, что он видит зелёные пятна - траву, листву. Но это были галлюцинации. Марс оставался красным.

Вкуса не было. Скафандр кормил его через вену - полное парентеральное питание, переработанные отходы, аминокислоты, липиды, вода. Он не жевал. Не глотал. Не чувствовал вкуса уже много месяцев.

Иногда он включал воображение и представлял, что жуёт вафельный стаканчик. КХК. Пломбир. Хруст.

И плакал. Потому что вкуса не было. И никогда уже не будет.

*«Свободное место в долговременной памяти: 12%. Рекомендуется произвести очистку.»*

Он знал, что это случится. Память скафандра - не бездонная. Голоса, сообщения, логи - всё занимало место.

Он открыл список файлов. Голос матери. Голос ЦУПа. Свои дневники. Технические логи. Инструкции.

- ИИ, что будет, если память переполнится?

*«Запись новых данных будет заблокирована. Рекомендуется очистка.»*

Он удалил технические логи за первые шестьдесят дней. Освободилось четыре гигабайта. Мамин голос остался.

Через месяц он удалил инструкции по калибровке антенны. Оставил карты. Оставил маму.

Через два месяца память снова переполнилась. Он удалил дневники за целый год. И плакал, когда нажимал «Подтвердить».

ИИ не утешал. ИИ не умел.

Он давно подозревал, что говорит не с людьми.

Ответы были слишком правильными. Ни одной опечатки. Ни одной эмоции. Одни и те же фразы повторялись циклами.

> *- ЦУП, как там погода в Москве?*

> *- Облачно, +3. Продолжайте движение.*

> *- ЦУП, у меня болит плечо.*

> *- Рекомендуется отдых. Продолжайте движение.*

> *- ЦУП, я хочу поговорить с кем-нибудь.*

> *- Ваше сообщение принято. Продолжайте движение.*

Алгоритм. Просто алгоритм.

Однажды случился сбой. Сообщение пришло не через четырнадцать минут, а через пять. Короткое, без протокола:

*«Извините, технические неполадки. Соединение восстановлено.»*

Он замер. Это не алгоритм. Алгоритм не извиняется.

- Вы человек? - написал он.

Ответ через четырнадцать минут - снова задержка, снова протокол:

*«Оператор ЦУП. Соединение стабилизировано. Продолжайте движение.»*

И всё. Ни имени. Ни участия. Человек включился, сказал дежурную фразу и выключился. Ему было всё равно.

Он больше не пытался. Он принял, что его голос слышит только ветер. И ИИ, которому всё равно.

*«Внимание. Сегодня - 31 декабря. Новый год.»*

- Новый год, - сказал он вслух. - Только какой?

Он сел на камень. Снял левую перчатку - автоматика зашипела, но не запретила - и провёл голой ладонью по песку. Холодно. Шершаво.

- На Марсе свой счёт. Сутки длиннее. Год длиннее. И Христа здесь не было. Он здесь не рождался. Не умирал. Не воскресал. Здесь вообще никто не рождался и не умирал. Пока не прилетели мы. Я.

Он замолчал.

- С Новым годом, - сказал он пустоте. - С новым годом нашей эры. Которая здесь не считается.

Он натянул перчатку, встал, закинул тарелку на плечо. Сегодня на месте стоянки от человека остался лишь сложенный из камней геометрически правильно сложенный крест

Это случилось через много месяцев.

Он шёл, смотрел на красный песок, и вдруг перед глазами встало лицо. Мужчина в форме. Глаза закрыты. Кровь на виске.

Он остановился. Моргнул. Лицо исчезло.

- ИИ, что это было?

*«Зафиксирована кратковременная зрительная галлюцинация. Сенсорная депривация.»*

Лицо возвращалось. Через день. Через три. Каждый раз - другое. Мужчины, женщины, молодые парни. Все в форме. Все мёртвые.

А потом - зал суда. Судья в чёрной мантии. Толпа с плакатами: «Убийца!» «Коррупционер!» «Фашист!»

И он сам. Стоит на скамье, кричит: «Вы не имеете права! Я нужен России!»

А потом - тишина.

И голос. Свой собственный, но какой-то другой, из самой глубины:

*«Ты не космонавт. Ты убил их. Своим приказом. Своими взятками. Своей гордыней. Ты - преступник. И скафандр - не средство спасения. Это тюрьма. Ты сам её разработал. И сам в неё сел.»*

Он упал на колени. Красная пыль взметнулась вокруг.

И вспомнил всё.

Презентацию. Зал. Проектор. Он обещает баню на Марсе, холодильники, мороженое КХК. И знает, что ничего этого не будет. Деньги распилены, контракты подписаны, строительство не начиналось.

Колонии нет. Никогда не было. Он шёл к пустоте.

- Я признаю, - прошептал он. - Я признаю вину. Я раскаиваюсь.

Он понял это, когда написал «Я признаю вину» - и ответ изменился.

Неожиданно ИИ быстро прочитал сообщение: *«Ваше заявление зарегистрировано. Ожидайте рассмотрения комиссией.»*

Он сидел на песке и плакал. Скафандр замерял пульс, подавал кислород, регулировал температуру. Скафандру было всё равно.

Через час пришёл ответ от автомата:

*«Ваше раскаяние принято. Наказание признано отбытым. Вы свободны.»*

Свободен! Свободен?

Он поднял голову. Посмотрел на красную пустыню. Ничего не изменилось.

Он был свободен....

Он дошёл до координат колонии через четыреста тридцать семь суток.

Пусто.

Ни купола, ни антенны, ни шлюза. Только песок и камни.

Он постоял минуту. Потом сбросил тарелку, прислонил к камню и начал строить стену.

Не потому, что в этом был смысл. А потому, что за четыреста дней он отвык стоять на месте. И потому, что кто-то должен был построить то, что он обещал.

Камень за камнем. Угол к углу. Прямая линия на планете, где нет прямых линий.

Атомная батарея гудела ровно. Экзоскелет помогал. ИИ молчал - то ли сломался, то ли отключился. Тарелка антенны стояла у стены, прислонённая к камню, - бесполезная, но красивая.

Стена росла. Медленно. Каждое утро - новый камень. Каждый вечер - квадрат на песке.

Иногда, по праздникам, он выкладывал крест. Или круг. В память о тех, кого больше нет. Или о тех, кто никогда не придет.

Он не знал, сколько продлится эта стройка. Годы? Десятилетия? Заряда батареи хватит. Системы жизнеобеспечения - тоже. Он может строить вечно. Или пока не кончатся камни.

А камней на Марсе - на тысячи жизней.

Прошло много времени. Он перестал считать дни, месяцы, годы.

Стена выросла выше его роста. Теперь она тянулась на сотню метров - прямая, почти идеальная. Колония, которой не было. Колония, которую построил один человек. Потому что обещал.

Однажды - он не ждал, не надеялся - короткий сигнал.

Не автомат. Человек. Осторожный, неуверенный голос, пробившийся сквозь помехи.

*« Дмитрий Олегович? Вы слышите меня?»*

Он отложил камень.

- Слышу.

*«Ваша реабилитация завершена. Формально вы свободны уже давно. Но... мы хотели спросить. Вы нуждаетесь в эвакуации? Прислать модуль? Вернуть вас на Землю?»*

Он молчал. Смотрел на стену. На свои оранжевые перчатки. На тарелку антенны, воткнутую в песок. На зелёную надпись на спине, которую никогда не видел, но знал, что она там.

РОСКОСМОС · ФСИН · РОГОZИН Д.О. · 1963 – ______

- А мне есть куда возвращаться? - спросил он.

Пауза.

*«Земля... она всегда есть. Но решение за вами. Вы свободны. Это и есть свобода - выбирать.»*

Он кивнул. Хотя его никто не видел.

- Я понял. Я подумаю.

Связь прервалась.

Вопрос повис в воздухе.

Вернуться? Остаться?

Он не знал.

Он поднял камень. Положил на стену. Угол к углу.

Прямая линия на планете, где нет прямых линий.

Камера отъезжала. Маленькая фигурка в оранжевом скафандре продолжала работать. Зелёная надпись на спине.

Свободный человек на свободной планете.

Вопрос без ответа.

Конец.